DPIA: il Garante fornisce chiarimenti interpretativi

Primo intervento del Garante privacy per semplificare l’applicazione dei dodici criteri secondo cui è necessario procedere con la DPIA.

Sono passati appena quattro mesi esatti dall’11 ottobre 2018, giorno in cui il Garante per la Protezione dei Dati Personali pubblicava, come allegato a un suo provvedimento, l’elenco delle tipologie di trattamenti soggetti al requisito di una valutazione d’impatto sulla protezione dei dati ai sensi dell’art. 35, comma 4, del Regolamento (UE) n. 2016/679, elenco che reca dodici casi tipo e che possono aiutare a determinare se sia o meno dovuta una DPIA nell’ambito della propria organizzazione.

La nota interpretativa.

Oggi, sul sito dell’Autorità, per rendere le cose più semplici e ridurre gli oneri a carico dei titolari del trattamento, è stato pubblicata una nota interpretativa che rende estremamente più circostanziati alcuni dei casi di cui sopra.

Dal sito, nella sezione dedicata alla DPIA, si legge che:

<<Si evidenzia come le espressioni trattamenti “sistematici” e “non occasionali” indicate nell’Elenco delle tipologie di trattamenti, soggetti al meccanismo di coerenza, da sottoporre a valutazione di impatto di cui ai punti 6, 11 e 12 sono riconducibili al criterio della “larga scala” così come espressamente illustrato al quinto criterio del WP 248 (pag. 11):

“5. trattamento di dati su larga scala: il regolamento generale sulla protezione dei dati non definisce la nozione di “su larga scala”, tuttavia fornisce un orientamento in merito al considerando 91. A ogni modo, il WP29 raccomanda di tenere conto, in particolare, dei fattori elencati nel prosieguo al fine di stabilire se un trattamento sia effettuato su larga scala:

- Il numero di soggetti interessati dal trattamento, in termini assoluti ovvero espressi in percentuale della popolazione di riferimento;

- Il volume dei dati e/o le diverse tipologie di dati oggetto di trattamento;

- La durata, ovvero la persistenza, dell’attività di trattamento;

- La portata geografica dell’attività di trattamento;”

Si evidenzia inoltre che il termine “dati biometrici” di cui al punto 11 dell’Elenco delle tipologie di trattamenti, soggetti al meccanismo di coerenza, da sottoporre a valutazione di impatto va inteso come “dati biometrici, trattati per identificare univocamente una persona fisica”>>.

Nello specifico i criteri la cui interpretazione è stata fornita dal Garante con la nota odierna, andrebbero riletti come segue:

- Criterio n° 6: Trattamenti non occasionali e su larga scala di dati relativi a soggetti vulnerabili (minori, disabili, anziani, infermi di mente, pazienti, richiedenti asilo).

- Criterio n° 11: Trattamenti sistematici e su larga scala di dati biometrici, tenendo conto, in particolare, del volume dei dati, della durata, ovvero della persistenza, dell’attività di trattamento.

- Criterio n° 12: Trattamenti sistematici e su larga scala di dati genetici, tenendo conto, in particolare, del volume dei dati, della durata, ovvero della persistenza, dell’attività di trattamento.

Conseguenze per i commercialisti e gli esperti contabili.

Alla luce della nota interpretativa fornita dal Garante, si può affermare con ragionevole certezza che i criteri 11 e 12 continuino a non trovare applicazione per gli studi dei professionisti e dei lettori-tipo di Fiscal Focus.

Lo stesso, purtroppo, non è possibile affermarlo in modo assoluto per il criterio n° 6, la cui applicabilità dovrà essere, di volta in volta, valutata caso per caso. Si pensi, per esempio, a chi si trova a gestire la contabilità di una casa di cura; in questo caso, trovo sia presente la possibilità che si vadano a trattare in modo regolare e sistematico i dati (per esempio la regolarità nei pagamenti delle rette o delle prestazioni) dei cosiddetti “soggetti vulnerabili”.

Fonte: Fiscal Focus

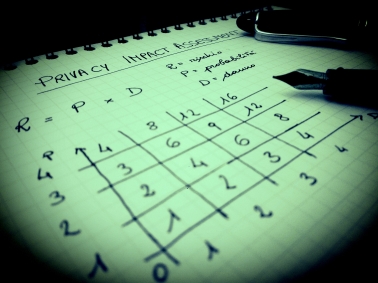

Apprezzabile, a mio modo di vedere, il fatto che sia richiamato il registro dei trattamenti del titolare, poiché può costituire una buona base di partenza – se fatto bene – per procedere con la valutazione del rischio. Attenzione però: coinvolgere attivamente gli eventuali responsabili del trattamento (oltre ai DPO) è importante. E qui entrano in gioco gli accordi che vincolano i titolari e i responsabili, per rispondere alle esigenze che emergono in un’ottica di garanzia e responsabilità, di gestione dei rischi, di gestione della qualità.

Apprezzabile, a mio modo di vedere, il fatto che sia richiamato il registro dei trattamenti del titolare, poiché può costituire una buona base di partenza – se fatto bene – per procedere con la valutazione del rischio. Attenzione però: coinvolgere attivamente gli eventuali responsabili del trattamento (oltre ai DPO) è importante. E qui entrano in gioco gli accordi che vincolano i titolari e i responsabili, per rispondere alle esigenze che emergono in un’ottica di garanzia e responsabilità, di gestione dei rischi, di gestione della qualità.